Hier, j’ai publié un billet dans lequel j’expliquais qu’il est important de comprendre la nature des outils d’IA que l’on utilise et de connaitre les stratégies qui permettent de bien les manipuler. Je présentais, pour finir, une liste de stratégies potentiellement utile, à la rédaction de bons prompts.

Je suis à l’aise avec l’IA, je l’utilise régulièrement et avec beaucoup de succès (il me semble), mais j’ai encore besoin de polir mes compétences alors je me suis imposé un petit exercice: choisir un sujet ou un problème et formuler des prompts en utilisant les stratégies présentées dans mon précédent billet pour l’explorer et me pratiquer.

L’argument contre l’utilisation de l’IA que je rencontre le plus fréquemment lors de formations, de conférences ou de discussions à propos de l’IA est la forte consommation en eau et en énergie de l’IA et son impact négatif sur l’environnement.

Honnêtement, j’aime croire que la situation s’améliore, mais j’ai très peu de preuves ou d’arguments à présenter mis à part mon optimisme un peu naïf de technophile.

Récemment j’ai bien croisé cette infographie qui m’a un peu encouragé (les sources de cette infographie sont au bas de l’infographie – ça semble crédible) parce qu’elle indique que la situation s’améliore. Les gros joueurs comme Meta et Google s’intéressent à la question. Bien honnêtement, malgré mon grand intérêt pour l’IA et la technologie, je n’arrive cependant pas à me convaincre que ce soit une technologie verte. Il y a bien plus d’aspects à considérer que la simple consommation d’électricité des serveurs et l’eau nécessaire pour les refroidir… Mais là s’arrête mes connaissance du sujet.

J’ai donc choisi ce problème: Quoi répondre aux participants des formations que je donne à propos de l’IA et de l’environnement.

Voici les prompts que j’ai utilisés, le détail des stratégies que j’ai tentées d’utiliser en référence à mon billet d’hier et une courte analyse du résultat. N’hésitez pas à commenter!

J’ai d’abord utilisé Gemini et mon premier prompt se voulait déjà assez complet. Je n’ai pas pris des heures pour le réfléchir, je n’ai pas consulté mes notes ou des sites pour améliorer mon prompt, mais j’ai tout de même fait attention. Je ne rêvais pas nécessairement d’un coup de circuit (une réponse satisfaisante du premier coup!), mais je voulais maximiser mes chances. J’ai donc déployé quelques stratégies:

- J’ai posé le contexte en même temps que le problème en espérant que la réponse soit adaptée.

- Je lui ai imposé un personnas (un rôle à jouer) pour l’obliger à adopter une posture et une manière de penser qui me semblait pertinente. Je voulais un regard critique, qui se souci des nuances et des détails. Ce faisant, je m’aperçois que j’ai un peu détourné le problème. Plutôt qu’une réponse à des étudiants, la discussion a plutôt pris la direction d’un portrait de la situation… Ça me semblait plus adapté avec ce personnas et j’ai donc ajusté mon prompt sans trop réfléchir aux conséquences. Ce n’est pas plus mal, mais il y a peut-être une légère différence dans la structure, le ton, la manière d’amener les informations… Déjà, cependant, on peut voir que le choix du personnas n’est pas sans conséquences et sans implications.

- J’ai implanté la stratégie du « chain of draft« pour l’obliger à réviser sa réponse avant de me la transmettre. Je voulais, de cette manière, mieux comprendre comment avait été élaborer la réponse à ma requête et m’assurer d’une réponse de meilleure qualité.

Voici mon prompt de départ:

L’argument contre l’utilisation de l’IA que je rencontre le

plus lorsque je donne des formations à du personnel scolaire, à des collègues

chercheurs ou à de futurs enseignants est la forte consommation en eau et en

énergie de l’IA et son impact négatif sur l’environnement.

Adopte la posture d’un journaliste d’enquête sérieux et consciencieux et

prépare un portrait le plus à jour possible de la situation actuelle en matière

de consommation énergétique et d’impact environnemental de l’IA. Rédige d’abord

un brouillon présentant tes arguments et les faits pertinents sous forme de

points clés, vérifie leur cohérence logique et leur véracité scientifique,

détermine les forces et les limites inhérentes à cette réponse puis rédige la

réponse finale.

La réponse était intéressante (ce lien mène vers ma conversation avec Gemini), mais le problème est complexe et je me demandais dans quelle mesure Gemini avait pris des raccourcis et si le choix du personnas amenait des biais? Je me suis questionné à ce sujet parce que la réponse avait vraiment l’allure d’un reportage. J’ai donc suivi les conseils reçus hier de Copilot et je lui ai carrément demandé:

est-ce qu’il y a des hypothèses implicites derrière cette réponse?

Et là, j’ai été surpris, la liste était plutôt longue… La réponse initiale n’était donc pas si bonne. À tout le moins, elle n’était assurément pas exempte de biais potentiels! Surtout, le choix du personnas avait eue une grande importance. Voici un résumé des hypothèses implicites cachées sous la réponse initiale de l’IA.

| Hypothèse implicite | Ce qu’elle sous-tend (Le postulat) | Le risque ou la limite (L’angle mort) |

| Effet de linéarité | L’optimisation technique suffira à réduire l’empreinte globale. | Paradoxe de Jevons : Plus l’IA est efficace, plus on l’utilise, ce qui augmente la consommation totale. |

| Compensation positive | L’IA « sauvera » le climat en optimisant les systèmes énergétiques. | Usage prédominant : Rien ne garantit que l’IA sera utilisée pour l’écologie plutôt que pour la consommation de masse. |

| Transparence des données | Les chiffres fournis par les entreprises (Big Tech) sont complets. | Sous-estimation : L’impact réel inclut aussi l’extraction minière et les déchets, souvent exclus des rapports. |

| Légitimité de l’usage | L’énergie utilisée pour l’IA est un investissement rentable pour la société. | Coût d’opportunité : Cette énergie est prélevée sur d’autres besoins (chauffage, santé, etc.) sans débat démocratique préalable. |

| Neutralité géographique | L’impact de l’IA est le même partout. | Mix énergétique : Une requête au Québec (hydro) n’a pas le même poids carbone qu’une requête en Virginie (charbon). |

Pour obtenir le tableau, j’ai simplement demandé à Gemini

Produit un tableau facile à copier qui résume les hypothèses implicites citées plus haut. Je suis en train d’utiliser cette discussion pour produire du matériel pédagogique et ça me serait utile.

La réponse de Gemini à propos des hypothèses implicites cachées derrières la réponse a semé en moi une préoccupation: comment choisir le bon personnas? Et je commençais aussi à réfléchir à comment j’aurais dû formuler mon premier prompt pour obtenir une meilleure réponse. J’ai donc décidé de m’inspirer de la technique de l’arbre de pensée pour évaluer l’importance des personnas. J’ai aussi utilisé une de mes stratégies favorites pour m’améliorer qui consiste, suite à un échange avec l’IA, à lui demander une rétroaction concernant mon prompt initial. Je lui ai donc demandé:

Je me demande si ta réponse aurait été très différente ou meilleure si, au départ, je t’avais demandé d’adopter la posture d’un autre « personnas »? Par exemple celui d’un enseignant bienveillant ou d’un analyste critique?

Identifie trois personnas potentiellement pertinent pour la production de cette réponse. Pour chaque personnas, évalue les avantages, les limites et les risques de biais auxquels les apprenants seraient confrontés sans le savoir si je leur transmettais la réponse de ce personnas. Choisis ensuite le personnas le mieux adapté, explique-moi pourquoi et formule le prompt que j’aurais du formuler au départ pour obtenir la meilleure réponses possible pour les participants à mes formations.

La réponse de Gemini montre très bien l’importance du personnas choisi et son impact sur la qualité de la réponse. Chaque personnas a un avantage et/ou une limite qui le distingue. Dans tous les cas, il y a toujours un biais potentiel! Utilisé une IA pour produire du matériel pédagogique n’est clairement pas exempt de biais. Comme pédagogue, je ne crois pas que ce soit très grave pour autant qu’on le garde en tête et qu’on le prenne en compte. Après tout, il y a probablement souvent des biais ou des hypothèses implicites cachées derrières notre matériel, nos interventions, nos prises de position, nos réponses aux questions…

| Persona | Avantages | Limites | Risques de biais (Invisibles) |

| L’Enseignant Bienveillant | Favorise l’engagement, vulgarise les concepts complexes et réduit l’anxiété liée aux changements technologiques. | Peut minimiser les aspects sombres pour ne pas décourager l’adoption de l’outil par ses élèves/collègues. | Biais d’optimisme : Présenter l’impact écologique comme un « défi à résoudre ensemble » plutôt que comme un obstacle structurel majeur. |

| L’Analyste Critique (Sceptique) | Déconstruit les discours marketing des Big Tech, expose les rapports de force et les coûts cachés (extraction minière, main-d’œuvre). | Risque de tomber dans un ton cynique ou fataliste qui bloque toute réflexion sur les usages pédagogiques positifs. | Biais de confirmation négatif : Sélectionner uniquement les données catastrophiques et ignorer les gains d’efficacité réelle pour valider une thèse anti-technologie. |

| L’Ingénieur en Développement Durable | Apporte une rigueur mathématique, parle en cycles de vie (LCA) et propose des solutions techniques concrètes. | Discours souvent trop technique ou aride, peut manquer de nuance sur les enjeux sociaux et pédagogiques. | Biais de solutionnisme technologique : Laisser croire que l’innovation technique seule (ex: fusion nucléaire, puces photoniques) réglera le problème sans changer nos comportements. |

J’ai ensuite copié le prompt que Gemini me proposait et je l’ai lancé dans Copilot (en utilisant GPT). Je saute souvent d’une IA à l’autre pour les comparer, mais aussi parce que je pense que même si j’avais créer une nouvelle conversation avec Gemini, il aurait pris en compte notre discussion courante. Disons que c’est une tentative pour minimiser les biais. Honnêtement, je ne sais pas si c’est fondé…

Selon Gemini, le prompt qu’il m’a proposé est un bon prompt pour les raison suivantes:

Contextualisation : Il précise le public (universitaires), ce qui élève le niveau de langage.

Éthique et Politique : Il force l’IA à sortir du simple constat technique pour entrer dans le domaine des valeurs (ce qui touche particulièrement les enseignants).

Appel à l’action : Il ne laisse pas l’apprenant passif devant un problème, il l’invite à la « sobriété numérique », un concept clé en éducation aux médias.

Voici le prompt « idéal » selon Gemini en fonction de notre conversation jusqu’à ce point. Remarquez comment il utilise un personnas, comment il donne un mandat clair et comment il place bien les contraintes à respecter et les formes de la réponses attendues.

Adopte la posture d’un analyste critique spécialisé en éthique des technologies et en écologie politique. Prépare une note de synthèse sur l’impact environnemental de l’IA destinée à des universitaires et des professionnels de l’éducation.

Ta réponse doit impérativement :

- Dépasser les chiffres de surface : Analyse l’ensemble du cycle de vie (de l’extraction du lithium pour les puces jusqu’aux déchets électroniques en fin de vie).

- Exposer les tensions : Confrontre les promesses de « Green AI » (l’IA pour le climat) avec la réalité de la croissance infinie de la demande énergétique.

- Éviter le manichéisme : Distingue les usages de l’IA qui ont une valeur sociétale ajoutée de ceux qui sont purement spéculatifs ou futiles.

- Proposer une réflexion sur la sobriété numérique : Quelles seraient les pistes de solutions concrètes pour une utilisation responsable de l’IA en milieu académique ?

Structure ta réponse avec des arguments étayés par des rapports récents, identifie tes propres limites et termine par une question provocatrice pour susciter le débat parmi les participants.

Première constatation, ce prompt a forcé Copilot à utiliser plusieurs références (28!). La réponse est ensuite très bien adaptée à un niveau universitaire. Ensuite, elle couvre plusieurs angles du problème et n’en cache pas la complexité. Le vocabulaire, par exemple, est précis et varié. Voici la réponse de Copilot (pas aussi facile de partager une discussion tenue avec Copilot que ça l’est avec Gemini… Je suis limité à partager avec des gens de mon organisation. Je vais donc copier le tout ici. Honnêtement, c’est une limite désagréable.)

Voici une note de synthèse critique adoptant une posture d’éthique des technologies et d’écologie politique, destinée à des universitaires et professionnel·les de l’éducation.

L’IA et son empreinte environnementale : une lecture systémique et critique

1. Dépasser les chiffres de surface : le cycle de vie complet de l’IA

La plupart des débats publics réduisent l’impact environnemental de l’IA à la consommation électrique des modèles ou des centres de données. Cette focalisation masque l’essentiel : l’empreinte de l’IA est systémique et cumulée, tout au long de son cycle de vie.

- Extraction et matériaux : Les puces (GPUs/TPUs) reposent sur des minerais critiques (lithium, cobalt, cuivre, terres rares). Leur extraction intensifie la destruction d’écosystèmes, la consommation d’eau et les conflits socio-environnementaux, notamment dans le Sud global. [unep.org], [nature.com]

- Fabrication : La production de semi-conducteurs est extrêmement énergivore et chimique intensive. Les analyses de cycle de vie (LCA) montrent que les émissions de fabrication représentent une part substantielle de l’empreinte totale des accélérateurs d’IA, parfois comparable à plusieurs années d’usage. [arxiv.org], [wsp.com]

- Infrastructure et usage : Les centres de données dédiés à l’IA concentrent des densités de puissance inédites (30–80 kW par rack), entraînant une hausse rapide de la consommation électrique (460 TWh en 2024 → ~1 000 TWh projetés avant 2030) et de l’empreinte hydrique, surtout via le refroidissement. [energy-pro…edings.org], [iea.org]

- Fin de vie : Le renouvellement accéléré des équipements augmente les déchets électroniques, dont moins de 20 % sont recyclés de manière adéquate à l’échelle mondiale, renforçant l’externalisation des nuisances environnementales. [unep.org]

Point clé : parler d’« IA sobre » sans intégrer extraction, fabrication et déchets relève d’une myopie carbone.

2. Les tensions du discours « Green AI »

Les promoteurs de la Green AI avancent que l’IA serait un outil clé pour la transition écologique : optimisation énergétique, modélisation climatique, réseaux intelligents. Ces bénéfices existent et sont documentés. [iea.org], [nature.com]

Cependant, une tension structurelle demeure :

- Les gains d’efficacité par tâche sont régulièrement compensés — voire dépassés — par l’explosion des usages (effet rebond).

- Les scénarios de l’IEA et de Nature Sustainability montrent que les centres de données sont l’un des rares secteurs dont les émissions augmentent à horizon 2030, même dans des trajectoires climatiques optimistes. [news.cornell.edu], [iea.org]

- Les études de revue systématique estiment que 30 à 60 % des gains d’efficacité sont annulés par la croissance de la demande, notamment pour les usages génératifs à faible valeur sociale (images, recommandations, automatisation attentionnelle). [frontiersin.org], [sciintl.scione.com]

➡️ L’IA pour le climat cohabite avec une IA du marché, guidée par l’expansion permanente des capacités et des usages.

3. Éviter le manichéisme : tous les usages ne se valent pas

Une approche éthique suppose de discriminer les usages, et non d’essentialiser l’IA.

- Valeur sociétale élevée :

- modélisation climatique et hydrologique ;

- détection précoce de pathologies ;

- optimisation de réseaux énergétiques publics ;

- soutien à l’accessibilité et à l’inclusion (traduction, aide aux handicaps).

- Usages discutables ou futiles :

- génération massive de contenus jetables (images marketing, deepfakes ludiques) ;

- hyper‑personnalisation publicitaire ;

- automatisation pédagogique non critique (feedbacks standardisés à grande échelle).

Les analyses de type life-cycle + usage-based ethics montrent que le coût environnemental marginal par gain social varie d’un facteur 10 à 100 selon les cas. [mdpi.com]

4. Vers une sobriété numérique académique : pistes concrètes

Dans l’enseignement supérieur, la sobriété ne signifie pas le retrait, mais le choix éclairé :

- Principe de nécessité pédagogique Utiliser de l’IA lorsque le gain pédagogique ou scientifique est explicite, documenté et non substituable.

- Préférence pour des modèles légers et mutualisés

- modèles open-source de petite taille ;

- mutualisation institutionnelle plutôt qu’outils individuels redondants.

- Allongement de la durée de vie des équipements

- priorité à l’optimisation logicielle plutôt qu’au renouvellement matériel. [digital.hec.ca]

- Formation critique des étudiant·es

- intégrer l’empreinte environnementale de l’IA aux compétences numériques (dans l’esprit DigComp/UNESCO). [link.springer.com], [oresquebec.ca]

- Transparence et gouvernance

- choix d’outils alignés avec des exigences de publication de données environnementales (LCA, énergie, eau).

Limites de cette analyse

- Les données industrielles restent partiellement opaques, reposant parfois sur des estimations.

- Les impacts varient fortement selon les mix énergétiques régionaux.

- Certaines externalités (biodiversité, justice sociale locale) sont encore sous‑quantifiées.

Pour ouvrir le débat

Si l’usage massif de l’IA exige une croissance continue de l’énergie et des ressources, l’université peut‑elle simultanément former à la transition écologique et normaliser des technologies structurellement insoutenables — ou devra‑t‑elle apprendre à dire non ?

Le prompt proposé par Gemini rapporte effectivement une bonne réponse quand je l’utilise dans Copilot. Mais, que cache-t-il? En demandant à Copilot si des hypothèses implicites étaient cachées derrière la réponse, je n’ai pas été déçu… (voir le tableau qui suit ce paragraphe!) Ça montre bien, encore une fois l’importance du personnas, mais aussi que l’IA ne nous donne pas accès à « la » vérité. Il faut demeurer très critique et lire avec beaucoup d’attention les réponses. Prendre du recul est une nécessité.

| Dimension | Hypothèse implicite | Formulation synthétique | Ce que cette hypothèse autorise | Ce qu’elle met en tension / exclut |

|---|---|---|---|---|

| Ontologique (nature de l’IA) | L’IA est un système socio‑technique | L’IA inclut matériel, énergie, chaînes d’approvisionnement, organisation du travail et modèles économiques | Une analyse en cycle de vie (LCA), une critique des infrastructures invisibles | La vision de l’IA comme simple outil immatériel ou neutre |

| Économique | La croissance des usages est structurelle | Les gains d’efficacité technique n’entraînent pas mécaniquement une baisse des impacts globaux | L’usage du concept d’effet rebond, la critique du solutionnisme technologique | L’idée que l’innovation verte suffit sans transformation économique |

| Normative / éthique | Tous les usages de l’IA ne se valent pas moralement | Il est légitime de hiérarchiser les usages selon leur valeur sociale et écologique | Une éthique de l’arbitrage (prioriser certains usages, en refuser d’autres) | La neutralité axiologique (“tout usage est équivalent”) |

| Politique | La sobriété est un choix collectif, pas individuel | Les impacts environnementaux ne peuvent être régulés uniquement par des gestes individuels | Une réflexion sur la gouvernance, la régulation, les politiques institutionnelles | La responsabilisation individualisante (“utilisez mieux l’IA”) |

| Pédagogique | L’université a une responsabilité exemplaire | L’enseignement supérieur produit des normes et légitime des technologies | Des politiques institutionnelles explicites sur l’usage de l’IA | La posture “suiveuse du marché” au nom de la compétitivité |

| Épistémologique | L’incertitude n’excuse pas l’inaction | Des données imparfaites suffisent pour agir face à des risques crédibles | Le recours au principe de précaution appliqué au numérique | Le report de décisions au nom du manque de mesures parfaites |

| Écologie politique | Les impacts sont délocalisés et asymétriques | Les coûts écologiques touchent surtout certains territoires et populations | Une lecture Nord–Sud, justice environnementale, critique des externalités | Une évaluation purement locale ou technocentrée |

| Critique de l’innovation | Le progrès technologique n’est pas intrinsèquement souhaitable | Toute innovation doit être interrogée quant à sa finalité sociale | La possibilité du renoncement sélectif | L’idéologie de la nouveauté permanente |

Je crois que je vais adopter cette habitude de demander à l’IA d’expliciter les hypothèses implicites cachées derrières ses réponses. C’est intéressant pour mieux comprendre et situer les réponses données. En recherche, ça me permettra notamment de rendre explicite les postures sous-jacente et facilitera le travail d’alignement des arguments et des cadres théoriques. Côté enseignement, je pourrai utiliser cette commande pour montrer l’importance de demeurer critique aux étudiants assis devant moi.

À ce stade de ma réflexion, j’ai rédigé une dernière commande pour Gemini.

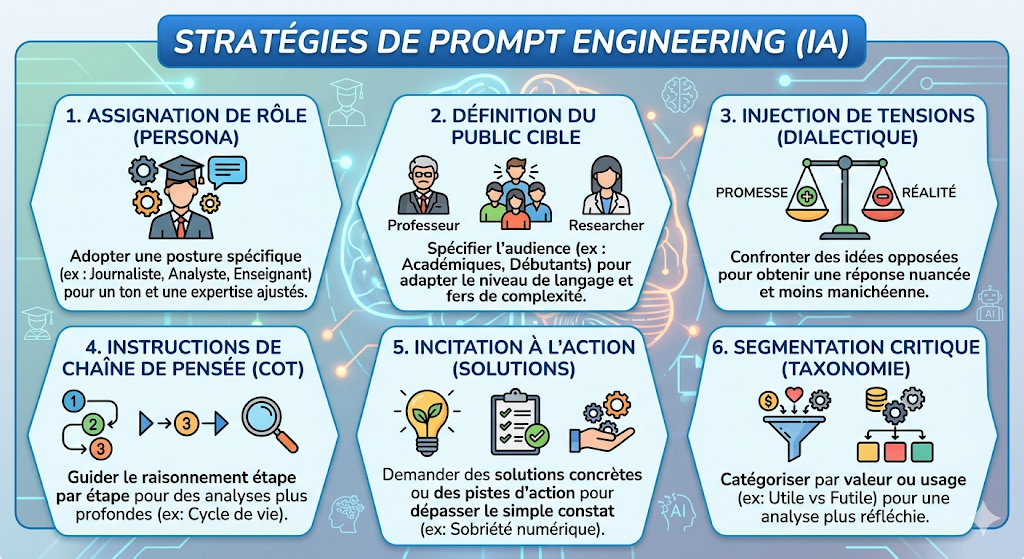

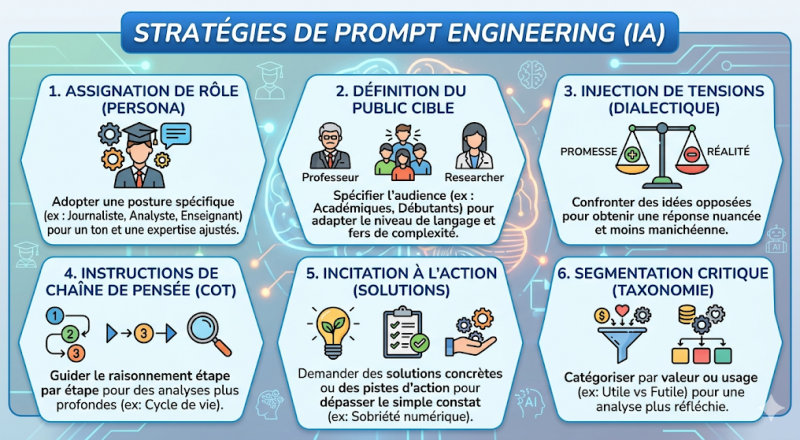

Explicite les stratégies de prompting que tu as implanté dans le « Prompt Ultime » que tu m’as proposé plus haut. Explique aussi l’effet recherché.

J’avais déjà un peu analyser le prompt fourni par Gemini plus haut, mais je me demandais s’il y avait plus de cacher derrière. De plus, c’est une de mes stratégies favorite… J’utilise souvent l’IA pour recevoir du feedback ou pour m’expliquer comment améliorer mes prompts. Ici, je lui ai demandé de m’expliquer ce qu’il avait fait. Dans ce cas, Gemini a été plutôt bavard et il a détaillé les techniques de « prompt engineering » qu’il a utilisé. Disons que mon analyse précédente (plus haut) était loin du compte! Voici ce qu’il avait à dire:

1. Assignation d’un Rôle Expert nuancé (Persona Adoption)

- La stratégie : J’ai choisi « Analyste critique spécialisé en éthique des technologies et en écologie politique ».

- L’effet recherché : Cela force l’IA à délaisser le ton « assistant généraliste » pour adopter un vocabulaire technique et conceptuel plus riche. En ajoutant « écologie politique », on l’oblige à traiter les données non pas comme de simples faits isolés, mais comme des enjeux de pouvoir et de société.

Je constate qu’il a été beaucoup plus en profondeur que moi dans la définition de la personnalité et des caractéristiques du personnas. Cette stratégie est décidément plus puissante que je le pensais.

2. Définition du Public Cible (Audience Specificity)

- La stratégie : Préciser que la note est destinée à des « universitaires et des professionnels de l’éducation ».

- L’effet recherché : L’IA ajuste son niveau de langue (registre soutenu) et sa densité informationnelle. Elle comprend qu’elle n’a pas besoin de définir les concepts de base, mais qu’elle doit plutôt se concentrer sur les nuances et la rigueur des sources.

C’est une stratégie que j’utilisais déjà fréquemment. Suite à la rédaction de ce billet, je constate par contre que, ce faisant, cela a eu comme conséquence que de nombreuses hypothèses implicites sont restées cachées aux destinataires de la réponses…

3. Contraintes de Cycle de Vie (Chain-of-Thought & Scope Expansion)

- La stratégie : L’instruction de « dépasser les chiffres de surface » et d’analyser « l’extraction du lithium jusqu’aux déchets ».

- L’effet recherché : On brise le biais de l’IA qui tend à se limiter aux données les plus documentées (la consommation électrique). On force une réflexion systémique (l’Analyse du Cycle de Vie – ACV), ce qui rend l’argumentaire beaucoup plus difficile à contester pour un public de chercheurs.

Ici, je constate que nos requêtes sont limités par nos connaissance du sujet. Je n’aurais pas pensé à cette nuances parce que je ne maitrise pas assez bien cette problématique. Conséquemment, un peu comme un algorithme sur les réseau sociaux, l’IA peut nous faire tourner en rond et nous maintenir dans une zone de confort qui ignore une partie de la réalité. C’est un peu comme une chambre d’écho! Vous serez satisfaits de la réponse parce dès le départ vous ignoriez ‘existence d’une partie des faits et, donc, vous n’avez pas pris la peine d’obliger l’IA à considérer cette autre partie de la réalité. L’IA vous éclaire de sa réponse, tout en vous maintenant dans la noirceur…

4. Injection de Tensions Dialectiques (Negative Constraints & Counter-Argumentation)

- La stratégie : « Confronte les promesses de Green AI avec la réalité de la croissance infinie ».

- L’effet recherché : On empêche l’IA de produire une réponse unidimensionnelle. En lui demandant de confronter deux réalités opposées, on génère une réponse nuancée qui reflète mieux la complexité du monde réel, évitant ainsi le techno-optimisme naïf.

Je vais tenter d’utiliser cette stratégies plus souvent. Forcer l’IA à confronter plusieurs points de vue et à fournir des réponses plus riches me semble une bonne idée pour qui tente d’être critique.

5. Segmentation par Valeur d’Usage (Critical Taxonomy)

- La stratégie : « Distingue les usages ayant une valeur sociétale ajoutée des usages futiles ».

- L’effet recherché : Cette stratégie déplace le débat de la quantité vers la qualité. Pour un personnel scolaire, c’est crucial : cela permet de justifier l’usage pédagogique (valeur haute) tout en critiquant l’usage de masse (valeur basse), rendant l’argumentation plus acceptable et moins culpabilisante.

6. Incitation à la Sobriété Numérique (Actionable Output)

- La stratégie : Demander des « pistes de solutions concrètes ».

- L’effet recherché : Éviter le sentiment d’impuissance. En forçant l’IA à être prescriptive, on transforme un constat alarmiste en un levier d’action pédagogique, ce qui est l’essence même d’une formation réussie.

7. Déclencheur de Débat (Engagement Trigger)

- La stratégie : Terminer par une « question provocatrice ».

- L’effet recherché : On utilise l’IA comme un catalyseur de discussion. Au lieu de clore le sujet par une conclusion fermée, on ouvre un espace de parole pour vos participants, renforçant leur rôle d’apprenants actifs.

Résumé technique du fonctionnement interne :

| Technique | Mécanisme | Résultat pour vos participants |

| Few-Shot / Zero-Shot Reasoning | L’IA puise dans ses connaissances académiques plutôt que populaires. | Crédibilité scientifique accrue. |

| Instruction-Following | Le respect strict des 4 points de la structure. | Clarté et structure de la présentation. |

| Contextual Priming | L’évocation de l’UQAC et de l’éducation prépare l’IA à être pertinente. | Sentiment de personnalisation et de proximité. |

Ce prompt est conçu pour être un « filtre de qualité » : il empêche l’IA de vous donner la réponse facile que tout le monde peut obtenir, pour vous offrir un contenu digne d’un séminaire de recherche.

Au final, j’ai encore des croutes à manger… Rédiger de bon prompt est beaucoup plus complexe que cela peut sembler. Voici une infographie produite par Gemini qui résume les techniques de prompt engineering qui ont été utilisée dans la discussion que j’ai eu avec lui aujourd’hui.

Et vous? Prenez-vous aussi le temps de réfléchir à vos prompts?

Comment faites-vous pour les améliorer?

Laissez-vous des traces quelque part que je pourrais consulter?

Quel billet!

Qui m’a fait réfléchir plusieurs jours d’ailleurs!

Mon usage de l’IA a radicalement évolué depuis mes premiers balbutiements avec GPT fin 2022.

Pour être honnête, je construis désormais très rarement des prompts de manière aussi structurée qu’avant.

Je cherche à me faire surprendre par l’IA.

Je cherche moins à obtenir des réponses toutes faites qu’à enrichir ma réflexion, explorer différentes perspectives et faire émerger des idées. Je dois avouer que j’ai vraiment l’impression d’être en co-création. Un projet complexe, autrefois impossible à réaliser sans investir des heures et des heures, pouvant se compter par centaines même, devient alors possible!

C’est un terrain de jeu infini.

Si je me recentre sur tes dernières questions, voici mes dernières petites astuces que j’affectionne davantage ces temps-ci:

-Demander à l’IA de simuler plusieurs experts qui débattent d’un sujet avant d’arriver à un consensus.

« Agis comme un panel composé d’un technopédagogue, d’un expert en expérience utilisateur (XYZ) et d’un critique de l’IA. Analysez ce projet sous vos angles respectifs, confrontez vos points de vue, puis proposez une synthèse optimisée. »

-Demander au modèle de critiquer sa propre réponse et de proposer une version 2.0 améliorée.

Une fois la première réponse générée, ajouter:

« Trouve trois failles logiques ou lacunes dans ta réponse précédente et propose une version 2.0 qui les corrige. »

-Demander à l’IA de croiser simultanément plusieurs formes d’information (texte, image, audio, vidéo, schéma, croquis, dessin, environnement physique) pour générer une analyse ou une création beaucoup plus riche.

« Analyse cette captation audio d’une classe, cette photo de l’aménagement des bureaux et ce plan de cours. En tant que designer pédagogique et spécialiste du bien-être cognitif et affectif, propose une transformation de l’espace et des activités pour augmenter l’engagement et réduire la surcharge sensorielle des élèves. »

À mon avis, le futur ne sera pas dominé par ceux qui “maîtrisent les prompts”..

Il appartiendra à ceux qui sauront :

Orchestrer des intelligences;

Créer des contraintes fertiles;

Provoquer des collisions d’idées;

Transformer l’IA en laboratoire cognitif plutôt qu’en distributrice de texte.

Le plus intéressant commence peut-être précisément au moment où l’on cesse de considérer l’IA uniquement comme un outil…

Le premier point clé est ta posture vis-à-vis de l’IA…

Je cherche moins à obtenir des réponses toutes faites qu’à enrichir ma réflexion, explorer différentes perspectives et faire émerger des idées. Je dois avouer que j’ai vraiment l’impression d’être en co-création.C’est la clé je crois. C’est très dangereux de demander des réponses à l’IA. Le processus de vérification est difficile et requiert beaucoup de temps et d’énergie.

J’aime bien l’idée de simuler un débat entre expert.

Demander à l’IA d’améliorer sa réponse est parfois dangereux. J’ai croisé une recherche qui remarquait que souvent, les version subséquente avait tendance à devenir de plus en plus « générique ». Il faut se méfier. Par contre, l’idée de demander au modèle de trouver des failles dans sa logique est intéressante. C’est un peu comme quand je lui demande de mettre à plât les hypothèse implicite derrière son raisonnement.

Ta conclusion est inspirante… je vais méditer sur ce sujet. Mais ne penses-tu pas que de savoir poser les bonnes questions puisse être une sorte de méta compétence nécessaire pour:

Orchestrer des intelligences;Créer des contraintes fertiles;

Provoquer des collisions d’idées;

Transformer l’IA en laboratoire cognitif plutôt qu’en distributrice de texte.