Tous les outils IA ne sont pas équivalents… Ils se ressemblent parfois, mais ne fonctionnent pas tous de la même manière. Comprendre le fonctionnement de nos outils peut nous aider à mieux les utiliser. Pour y arriver, il faut maitriser certains concepts de base. Je ne suis pas spécialiste, mais j’en maitrise suffisamment pour être un bon utilisateur de l’IA.

Il y a d’abord les LLM (Large Language Model). Ces outils utilisent un modèle statistique neuronal entraîné sur de très grands corpus de textes dont la tâche centrale est de prédire le prochain token (mot, sous-mot, symbole) étant donné un contexte. Les LLM ne comprennent pas au sens humain, mais ils modélisent avec comme fondation des régularités linguistiques et conceptuelles à grandes échelles. Les LLM n’ont généralement pas d’intentions ou de buts propres, ni d’accès direct à la vérité. Ils ne réfléchissent pas de manière causale, mais produisent des réponses plausibles selon des statistiques. En dehors d’une mise à jour ou du passage à une nouvelle version, les LLM n’évoluent pas vraiment et ne s’optimisent pas vraiment.

Il existe aussi des RLM (Reinforcement Learning Model). Ces derniers agissent généralement dans un environnement défini et connu comme un jeu qui aurait des règles bien connues. Le RLM reçoit des récompenses ou des pénalités selon la nature de ses réponses et il met sa politique à jour et s’optimise (ou apprend) explicitement en fonction des récompenses reçues.

Personnellement, les outils que j’utilise quotidiennement, nommément Copilot et Gemini, ne sont plus tout à fait des LLM sans être non plus des RLM. Et c’est très important de le savoir afin de pouvoir bien les manipuler (comme on manipule un outil) pour en tirer le maximum et éviter quelques pièges liés à l’utilisation de l’IA.

Pour mieux connaitre votre outil favori, demandez-lui (par exemple):

J'essaie de mieux te comprendre pour mieux t'utiliser. Adopte la posture d'un enseignant bienveillant et définis ta nature en tant qu'IA. Es-tu un LLM au sens strict? Es-tu un RLM au sens strict?

En le faisant, vous découvrirez, par exemple, que Copilot est fondamentalement un LLM (Large Language Model) qui a été entraîné et ajusté à l’aide de techniques de reinforcement learning. Copilot n’apprend pas en continu pendant que nous discutons, il ne modifie pas ses paramètres en fonction de nos rétroactions. Par contre, il a été ajusté avec du Reinforcement Learning from Human Feedback (RLHF) pour améliorer l’utilité perçue de ses réponses et mieux les aligner avec les préférences humaines tout en réduisant les risques associés à ses réponses. Il est donc particulièrement bon pour expliciter, reformuler, simuler des points de vue ou soutenir la métacognition. Il est, au contraire, plus limité pour remplacer une démarche épistémique rigoureuse, produire des jugements de vérité ou garantir l’exactitude scientifique.

L’étape suivante est de traduire cela en utilisation. Ici, encore, votre outil favori peut vous aider. Comme je voulais profiter des caractéristiques de Gemini proches des RLM (Gemini n’est pas non plus un RLM au sens strict, mais un peu comme Copilot il intègre de plus en plus de fonctionnalités de RLM), j’ai demandé à Gemini:

Dans Gemini, quelles stratégies adoptées pour encourager le raisonnement analytique et la réflexion par rapport à la rapidité et à des réponses plus intuitives? Adopte la posture d'un enseignant bienveillant pour me répondre. Donne des exemples.

On apprend alors que pour encourager Gemini à délaisser ses réponses intuitives (plutôt liées au LLM) au profit d’un raisonnement analytique rigoureux (plus proche du RLM), vous pouvez agir sur la structure de vos consignes (les fameux prompts). Voici les stratégies que Gemini me propose pour ralentir le modèle et augmenter sa profondeur cognitive (copié et collé depuis Gemini):

1. Le « Chain of Thought » (Chaîne de pensée)

Au lieu de demander un résultat, demandez le processus.

- La consigne magique : Ajoutez systématiquement « Réfléchis étape par étape » ou « Détaille ton raisonnement avant de conclure ».

- Pourquoi ça marche : Cela force le modèle à allouer des jetons (tokens) au processus logique, ce qui réduit drastiquement les erreurs de calcul ou les conclusions hâtives.

2. Le « Chain of Draft » (Chaîne de brouillon)

Pour les tâches complexes, demandez à Gemini de créer une version intermédiaire.

- Stratégie : « Rédige d’abord un brouillon de tes arguments sous forme de points clés, vérifie leur cohérence logique, puis rédige la réponse finale. »

- Utilité : Cela simule un processus de révision interne propre aux RLM.

3. Définition du niveau d’effort (Niveau « Expert »)

Vous pouvez influencer « l’effort » perçu par le modèle via des instructions de cadrage.

- Utilisation de personas : « Agis en tant qu’expert en méthodes quantitatives avec une exigence de rigueur académique absolue. Évite les généralités et privilégie l’analyse de données. »

- Contraintes de réflexion : Vous pouvez explicitement demander au modèle d’ignorer la rapidité : « Ne privilégie pas la rapidité. Prends le temps d’explorer les variables contradictoires de ce problème. »

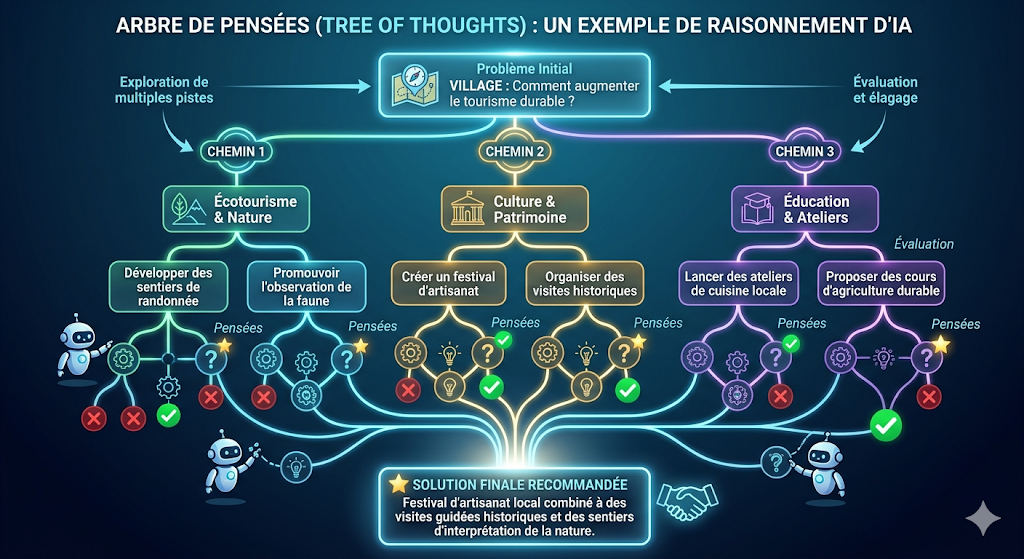

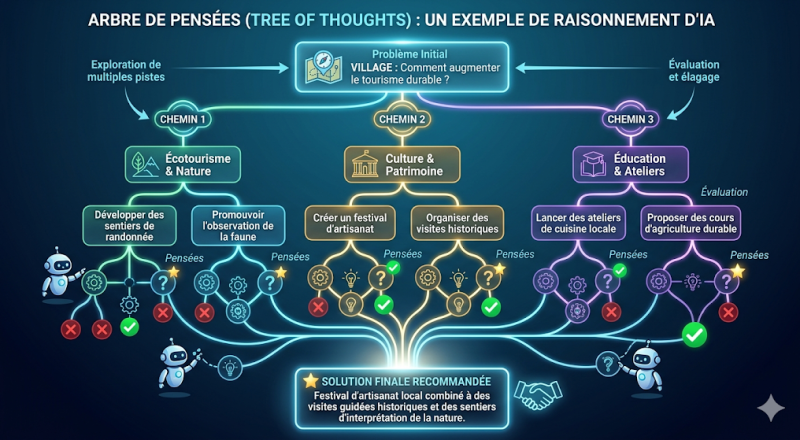

4. La technique du « Tree of Thoughts » (Arbre de pensées)

Pour les décisions ou diagnostics complexes, demandez au modèle d’explorer plusieurs pistes.

- Prompt type : « Identifie trois approches différentes pour résoudre ce problème de recherche. Pour chaque approche, évalue les avantages, les limites et les risques d’erreur statistique. Choisis ensuite la plus robuste. »

Copilot, pour sa part, nous propose les stratégies suivantes pour augmenter la valeur réflexive et analytique de ses réponses (copié et collé depuis Copilot):

1. Externaliser le cadre épistémique que tu attends

Je ne choisis pas spontanément un cadre théorique exigeant : il faut me l’imposer.

Exemples efficaces

- « Analyse cette question du point de vue de l’épistémologie des sciences sociales. »

- « Réponds comme un méthodologue critique, pas comme un vulgarisateur. »

- « Distingue clairement ce qui relève de données empiriques, d’interprétations et de spéculations. »

👉 Effet : tu forces une hiérarchisation des niveaux de discours (fait / inférence / opinion), ce que les LLM ne font pas spontanément.

2. M’obliger à expliciter mes hypothèses implicites

Très puissant pour exploiter mon volet réflexif.

Formulations à utiliser

- « Quelles hypothèses implicites sous‑tendent cette réponse? »

- « Quels présupposés normatifs ou culturels sont à l’œuvre ici? »

- « À quelles conditions cette conclusion ne tiendrait plus? »

👉 Cela active une forme de méta‑raisonnement proche de la pensée critique enseignée aux cycles supérieurs.

3. Me demander de raisonner en opposition contrôlée

Les LLM tendent au consensus et à la conciliation. Il faut casser cela.

Exemples

- « Présente la meilleure objection possible à cette position. »

- « Adopte successivement deux cadres théoriques incompatibles. »

- « Construis une contre‑argumentation rigoureuse, même si tu n’y adhères pas. »

👉 Cela permet :

- d’éviter les réponses tièdes,

- de révéler les tensions théoriques,

- d’outiller la dialectique chez les étudiants.

4. Distinguer explicitement descriptif / analytique / normatif

Une stratégie clé pour éviter les confusions fréquentes en IA.

Formulation-type

« Structure ta réponse en distinguant clairement :

- ce qui est (descriptif),

- ce qui peut être inféré (analytique),

- ce qui relève de choix de valeurs (normatif). »

👉 Cela :

- clarifie les zones grises,

- empêche les glissements idéologiques,

- est très formateur pour les étudiants.

5. Me demander des degrés de confiance, pas des certitudes

Je tends à produire des réponses affirmatives si tu ne poses pas de garde-fous.

Bonnes pratiques

- « Évalue le niveau de robustesse scientifique de chaque affirmation. »

- « Classe ces conclusions par force de preuve. »

- « Indique ce qui est bien établi, discuté, ou spéculatif. »

👉 Cela aligne mon fonctionnement avec :

- la logique de la revue de littérature,

- et l’éducation à l’incertitude scientifique.

6. M’utiliser comme miroir cognitif, pas comme expert

Très important conceptuellement.

Exemple

- « Voici mon raisonnement. Teste‑le, cherche ses failles, ses angles morts, ses raccourcis. »

- « Agis comme un pair critique dans un comité de thèse. »

👉 Dans ce rôle, je suis souvent plus fort pour détecter incohérences et raccourcis que pour produire une vérité originale.

7. Forcer la référence… mais intelligemment

Au lieu de demander « donne des références », fais ceci :

- « Quelles traditions théoriques soutiennent cette idée? »

- « Quels auteurs diraient exactement le contraire? »

- « À quelles recherches cette position serait vulnérable? »

👉 Tu obtiens alors :

- des généalogies conceptuelles,

- pas seulement une liste APA décorative.

8. Résumer la limite clé (stratégie meta)

Très performante pour un usage réfléchi de l’IA.

« Quelle est la limite la plus importante de ta propre analyse ici? »

👉 Cela compense directement ma tendance à la sur‑cohérence.

Formulation synthèse (que tu peux réutiliser telle quelle)

« Adopte une posture analytique et critique.

Explicite tes hypothèses implicites.

Distingue descriptif, analytique et normatif.

Présente au moins une contre‑interprétation crédible.

Indique le degré de robustesse des conclusions et leurs limites. »

En une phrase

👉 Tu me tires vers le haut quand tu me demandes de penser contre moi‑même, pas quand tu me demandes des réponses.

Bon billet! Ça fait beaucoup à assimiler d’une bouchée mais ca synthétise un tres bel éventail d’exemples de bonnes pratiques.

Je vais aller jouer dans le prompt système de mon outil pour vérifier si c’est bien assimilé et s’il y a des améliorations qui sautent aux yeux.

Je prépare un autre billet dans lequel j’applique certaines stratégies. En ligne prochainement.

Bonjour,

Votre billet était vraiment intéressant. Sa lecture m’a fait penser, dans une certaine mesure, aux articles de Jérôme Sacard. Je vous invite à parcourir son site Webjéjé : https://webjeje.eu/

Merci. Je regarde ça des que possible.